[AWS re:Invent 2018] Deep Learning for Edge to Cloud – AIM315-R1 #reinvent

こんにちは。データサイエンスチームのtmtkです。

11月25日よりはじまったAWS re:Invent 2018に、当社からは私を含む若手エンジニア4人が参加しています。

この記事では、「Deep Learning for Edge to Cloud」というワークショップの内容をレポートします。

概要

セッションカタログから概要を引用します。

In this workshop, you step into the role of a startup that has assumed the challenge of providing a new type of EDM music festival experience. Your goal is to use machine learning (ML) to develop a connected fan experience that enhances the festival. Come and get hands-on experience with Amazon SageMaker, AWS DeepLens, Amazon Rekognition, and AWS Lambda as you build and deploy an ML model and then run inference on it from edge devices.

要約すると、AWS DeepLensを使ってディープラーニングをするワークショップです。

AWS DeepLensはAWSが販売しているデバイスで、Ubuntuが入っている小型PCにカメラをつけたようなものです。DeepLensをつかうと、ディープラーニングを実践しながら学ぶことができます。Amazon.comで販売されていますが、2018年11月現在では日本へは発送できないようです。(技適の関係だといううわさです。)

内容

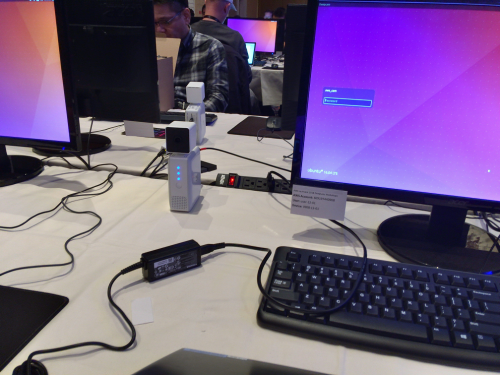

ワークショップの部屋では、DeepLensとモニタ、キーボード、マウスが一人一つ分用意されており、またAWSのアカウントも用意されていました。

ワークショップのアジェンダ

- ディープラーニングの概要

- AWS DeepLensとプロジェクトのデプロイについての概要

- ワークショップ シナリオと実践

- Part1:エッジでの顔検出のプロジェクトをつくり、デプロイ

- Part2:フェスに参加した観客の感情を認識し分析

はじめの30分ほどで解説、残りの90分ほどで実習です。

解説では、ディープラーニング、AI、機械学習、データ、モデルの訓練、推論、アノテーション、前処理などのキーワードや、DeepLensについて、ざっくりとした説明がありました。今回つくるシステムについても簡単な説明がありました。

課題の状況設定としては、自分は音楽フェスの開催者であり、フェスの参加者が楽しんでいるかモニターしたいというものです。ステージごとにフェスの参加者が楽しんでいるかをモニターし、それを伝えることで、参加者はどのステージが一番楽しそうか知ることができ、また演奏者も自分の演奏に客が満足したかを知ることができるか知ることができます。

ワークショップの課題はすべてGitHubのリポジトリに用意してあります。

課題1は、DeepLensのカメラで顔検出をし、結果をAWS IoTに送信するというものです。これはDeepLensのテンプレートプロジェクトを使うと簡単にできます。

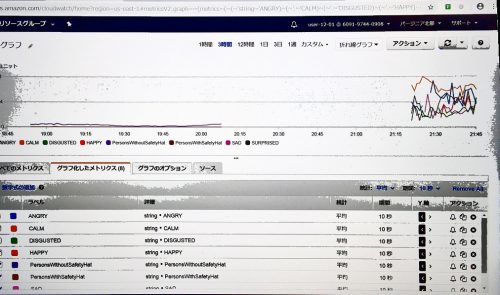

課題2は、DeepLensとAmazon RekognitionとAmazon CloudWatchを連携させるものです。DeepLensで顔を検出し、Amazon Rekognitionで検出した顔の感情を分析します。感情分析の結果をCloudWatchに送信し、CloudWatchでそれを分析するというものです。

おみやげとして、DeepLensの割引券をもらいました。

感想

DeepLens、Lambda、Rekognition、S3、SageMaker、CloudWatchなどの幅広いAWSのサービスを活用して、短時間で実践的なアプリケーションを作りました。実践的なユースケースでいろいろなサービスをさわってみるのは非常に勉強になりました。

データ分析と機械学習とソフトウェア開発をしています。 アルゴリズムとデータ構造が好きです。

Recommends

こちらもおすすめ

-

[AWS re:Invent 2018]認定者ラウンジはすごかった #reinvent

2018.11.27

-

畳み込みニューラルネットワークの畳み込み層の重みを可視化する方法

2018.7.10

Special Topics

注目記事はこちら

データ分析入門

これから始めるBigQuery基礎知識

2024.02.28

AWSの料金が 10 %割引になる!

『AWSの請求代行リセールサービス』

2024.07.16